盡管目前VLM在多模態任務上表現突出,但訓練過度依賴人工標注的數據與精心設計的強化學習獎勵。這種依賴帶來數據稀缺問題:多模態標注成本高昂,限制了訓練數據的規模與多樣性。同時存在知識天花板:模型能力受人類監督邊界限制,難以突破人類已有知識和策略。曾經AlphaGo所使用的自博弈技術通過模型與自身副本競爭交互并自動獲取反饋,把計算轉變為數據的同時消除了對人工監督的依賴,這使得它能夠持續推動模型進步并突破人類能力上限。但是受制于VLM的多模態特性,目前鮮有對自博弈在VLM上應用的系統性研究。為此研究團隊設計了一套適應VLM特性的自博弈框架Vision-Zero,此框架有如下特點:

(1)策略自博弈框架:Vision-Zero在以社交推理類游戲為模板的環境中訓練VLM,使得agent在自博弈過程中自動生成高復雜度推理數據,而無需人工標注。

(2)任意形式的圖片都可作為輸入:和以往有限制條件的游戲化訓練框架不同的是,Vision-Zero可在任意形式的圖片上啟動游戲,這使得模型可以在很多不同的領域里獲得相應的能力提升,并有很好的泛化性能。

(3)持續的性能提升:研究團隊提出了自博弈和可驗證獎勵的強化學習(RLVR)交替優化的自博弈策略優化算法(Iterative-SPO),這一算法解決了傳統自博弈算法中常見的性能瓶頸問題。

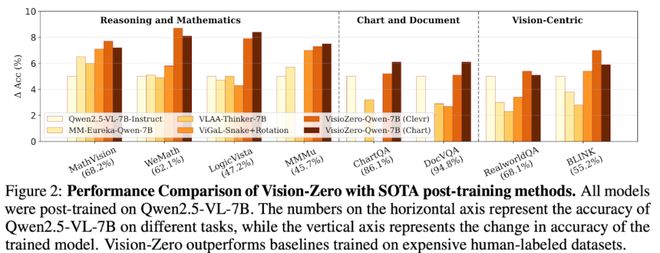

盡管沒有用任何標注數據做訓練,Vision-Zero在多個領域如推理,圖表問答和Vision-Centric理解任務上超越了其他有標注的SOTA后訓練方法。

從棋盤到現實:

AlphaGo自博弈思想的泛化

自博弈作為OpenAI早期的重要技術路線之一,也是人工智能發展歷程中多項里程碑事件的關鍵推動力。典型代表包括2016年AlphaGo戰勝李世石,以及2019年OpenAI Five在Dota 2上擊敗世界冠軍OG戰隊。人們在看到自博弈在某些特定領域大幅超越人類智能的同時,往往也會思考我們是否有可能把這種思想應用到更多的開放場景中。然而讓AlphaGo從棋盤走入現實需要解決以下幾個難題:

(1)Agent為贏得博弈所習得的技能,應當與目標任務所需的技能高度一致。

(2)博弈環境應當足夠多樣且復雜,以便廣泛的目標任務都能夠滿足條件(1)。

(3)技能增長應當具有可擴展性:隨著自博弈的進行,環境應當不斷提高難度,使得越來越強的智能體能夠涌現,而不是讓訓練收斂到一個固定的上限。

受到社交推理游戲,如“誰是臥底”的啟發,研究團隊設計了一套完備的自博弈規則以解決上述難題,具體規則如下:

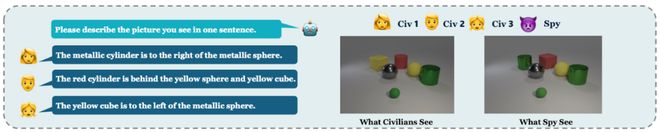

(1)游戲中有n名平民和1名臥底。玩家首先被告知自己的角色。

(2)每名玩家會得到一張圖片,臥底的圖片與平民略有不同(如缺失、添加或修改了某個物體)。

(3)線索階段:每位玩家觀察自己的圖片,并給出一個口頭線索,描述圖片內容(可以是物體描述、推斷信息等)。

(4)決策階段:多輪線索給出后,進入決策階段。玩家根據線索結合自己的圖片,投票找出臥底。

此游戲具有高度策略性與挑戰性,臥底需要根據他人線索推斷并偽裝自己,避免暴露。平民需要提供足夠準確但不泄密的線索,同時分析他人線索尋找可疑點。如此一來,Agent在游戲過程中便可生成足夠長且復雜的推理鏈條,并且隨著對手能力的提升,其所面臨的挑戰也會越來越大,并被激發出更強的視覺理解與推理能力。